در سال ۲۰۱۹ فردی با استفاده از فناوری شبیهسازی صدا و تماس با مدیرعامل یک شرکت تأمین انرژی در انگلیس، توانست خودش را به عنوان رئیس شرکت اصلی که در آلمان مستقر بود جا بزند و از شرکت انگلیسی تقاضای انتقال فوری مبلغی معادل ۲۴۳۰۰۰ دلار را داشته باشد. مدیر شرکت انگلیسی بدون ذرهای تردید، هویت تماسگیرنده را به عنوان رئیس شرکت آلمانی باور کرده بود. فرد تماس گیرنده توانسته بود با استفاده از هوش مصنوعی لهجه آلمانی و آهنگ صدای رئیس شرکت مادر را شبیهسازی کند.

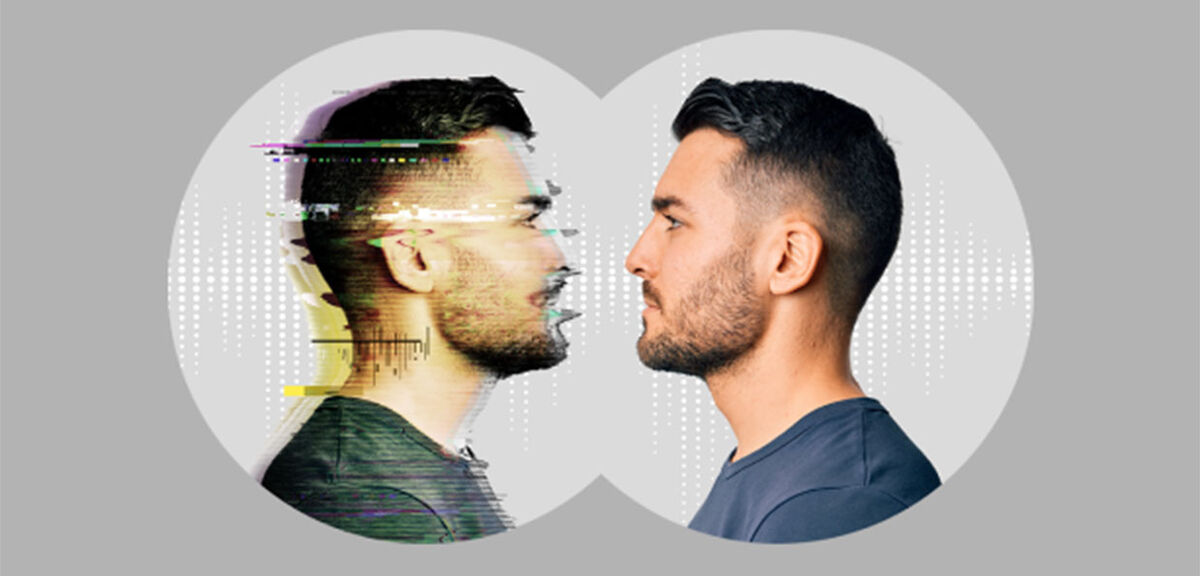

اما فناوری هوش مصنوعی شبیهسازی صدا چگونه کار میکند؟ AI Voice Cloning یک تکنیک دیپ فیک است که میتواند صدای انسان را تجزیهوتحلیل و تکرار کند. تنها چیزی که نیاز دارد نمونه صدای کوتاهی از فرد مورد نظر است و هوش مصنوعی فوراً آن را یاد میگیرد. بعد از دانستن نحوه کار ابزار شبیهسازی صدای هوش مصنوعی میتوان به راحتی از آن استفاده کرد.

اقتضائات شبکههای اجتماعی نیز به این امر کمک میکند. فرد کلاهبردار به راحتی میتواند صدای فرد موردنظر را از صفحه شخصی او در فضای مجازی برداشته و به نرمافزار شبیهساز وارد کند. سپس فایل صوتی که خودش آماده کرده است را از طریق شبکه اجتماعی یا یک پیامرسان برای فرد مالباخته ارسال کند. کاهش کیفیت صدا در بستر اینترنت و وجود نویز در صدایی که در فضاهای باز ضبط میشوند به کمک کلاهبردار آمده و تشخیص جعلی بودن صدا را برای مالباخته دشوارتر میکند.

تاکنون موارد زیادی از این دست کلاهبرداریها از سرتاسر جهان گزارش شده است که «کلاهبرداری از سالمندان آمریکایی» متداولترین نوع آن بوده است.

کلاهبردارن آمریکایی با استفاده از این فناوری با سالمندان تماس گرفته و خود را به عنوان فرزندان و بستگان آن سالمند معرفی میکنند. کلاهبردارن پس از کسب اعتماد سالمند، از او تقاضای پول کرده و بهراحتی توسط خود فرد حسابش را خالی میکنند.

براساس جدیدترین یافتههای محققان که فاکسنیوز آن را منتشر کرده است؛ انسانها توانایی تشخیص صدای شبیهسازی شده با هوش مصنوعی را ندارند. این گزارش تأکید میکند باوجود آنکه برخی از افراد شرکتکننده در این پژوهش قبلاً برای تشخیص صدای جعلی آموزش دیده بودند؛ بازهم فریب خوردند.

با توجه به فراگیری روزافزون هوشمصنوعی و کاربردهای آن، لزوم ایجاد سازوکاری برای مقابله با سوءاستفادهکنندگان از این فناوری بیش از پیش احساس میشود. چه بسا شرکتهای امنیت نرمافزار آنگونه که در گذشته آنتیویروسها را تولید کردند، تصمیم به تولید امکانی برای تشخیص هویتهای جعلی بگیرند.

نظر شما